Une intelligence artificielle modifie des vidéos pour qu’elles correspondent à vos corrections des dialogues

Si vous savez utiliser un clavier d’ordinateur, vous pouvez maintenant créer un deepfake/ hypertrucage convaincant.

Les progrès récents de l’intelligence artificielle ont beaucoup facilité la création de clips vidéo ou audio dans lesquels une personne semble dire ou faire quelque chose qu’elle n’a pas vraiment dit ou fait.

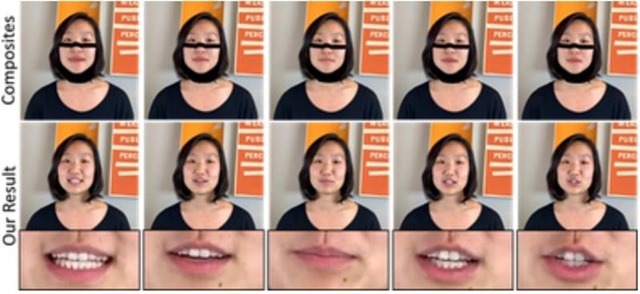

Aujourd’hui, une équipe de chercheurs a mis au point un algorithme qui simplifie le processus de création d’un deepfake à un degré encore un peu plus terrifiant, faisant « dire » au sujet d’une vidéo tout ce qui est inscrit dans le script du clip, et les chercheurs de s’inquiéter de ce qui pourrait arriver si cette technologie tombait entre de mauvaises mains.

Les chercheurs de l’université de Stanford, de l’université de Princeton, du Max Planck Institute for Informatics et d’Adobe, expliquent comment fonctionne leur nouvel algorithme dans un article publié cette semaine (lien plus bas) sur le site Web du scientifique Ohad Fried de Stanford.

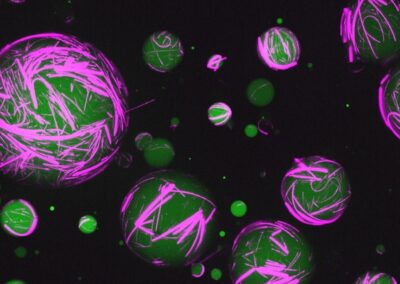

Tout d’abord, l’IA analyse une vidéo source d’une personne qui parle, mais il ne s’agit pas seulement de regarder ses paroles, il faut identifier chaque petite unité sonore, ou phonème, que la personne émet, ainsi que l’aspect qu’elle a quand elle dit chaque mot.

Il n’y a qu’environ 44 phonèmes en anglais, et selon les chercheurs, tant que la vidéo source dure au moins 40 minutes, l’IA aura assez de données pour rassembler tous les éléments dont elle a besoin pour faire dire n’importe quoi à une personne donnée.

Après cela, il reste juste à éditer la transcription de la vidéo, et l’IA va générer un deepfake qui correspond à la transcription réécrite en assemblant de manière intelligente les sons nécessaires et les mouvements buccaux.

Sur la base de la vidéo montrant le nouvel algorithme en action, il semble mieux adapté à de petits changements. Dans un exemple, les chercheurs démontrent comment l’IA peut remplacer le mot « napalm » dans la célèbre citation « Apocalypse Now », « I love the smell of napalm in morning », par « French toast », beaucoup plus anodin.

Mais même eux craignent que certains puissent trouver des utilisations beaucoup plus néfastes à ce nouvel algorithme.

Selon les chercheurs dans leur document de recherche :

Nous reconnaissons que de mauvaises personnes pourraient utiliser ces technologies pour falsifier des déclarations personnelles et calomnier des personnalités éminentes.

Nous estimons qu’un solide débat public est nécessaire pour créer un ensemble de lois et de règlements appropriés qui permettraient d’équilibrer les risques liés au mauvais usage de ces outils avec l’importance des cas créatifs et consensuels.

L’étude et la présentation de l’IA sur le site du scientifique Ohad Fried : Text-based Editing of Talking-head Video.

[totaldonations_circle_bar id="81539"]

Il n'y a pas de publicité ici et le Guru tente, cette semaine, de réunir les fonds nécessaires pour continuer à faire vivre GuruMeditation. On y est presque et votre aide est absolument nécessaire et cela se passe ici.