Un algorithme peut produire des images en 3 dimensions à partir d’images en 2 dimensions

On aimerait tous que nos photos aient beaucoup plus de profondeur… Des chercheurs de l’université de Washington à St. Louis (WU/ Etats-Unis) ont mis au point un algorithme d’apprentissage automatique capable de le faire.

Mis au point à la McKelvey School of Engineering de la WU, cet algorithme peut créer une structure 3D continue à partir d’images 2D plates. Jusqu’à présent, le système a été utilisé pour créer des modèles de cellules humaines à partir d’un ensemble d’images partielles prises avec des outils de microscopie standard utilisés aujourd’hui.

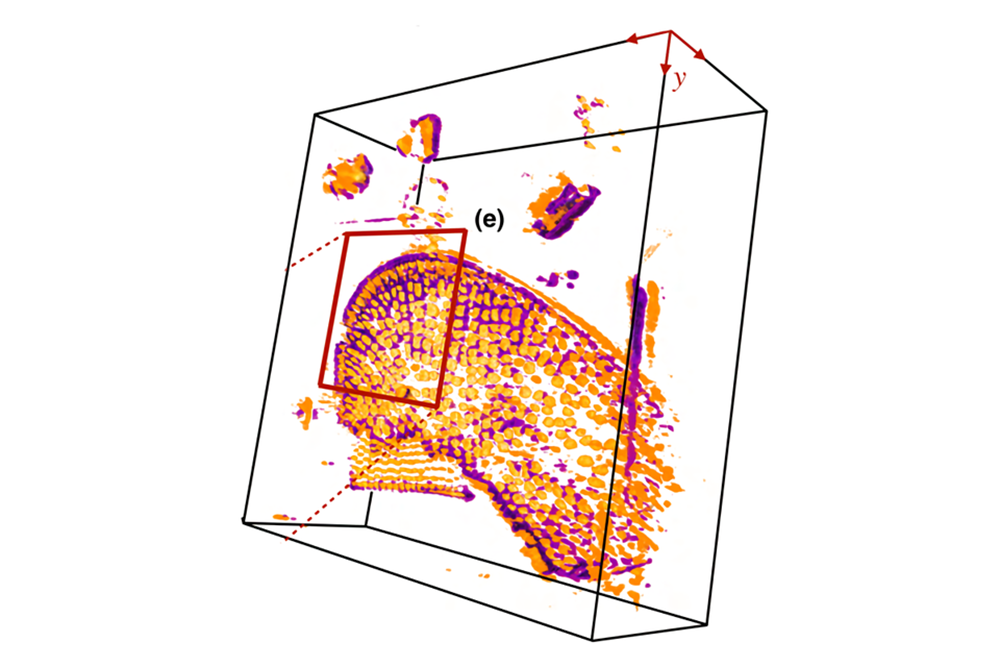

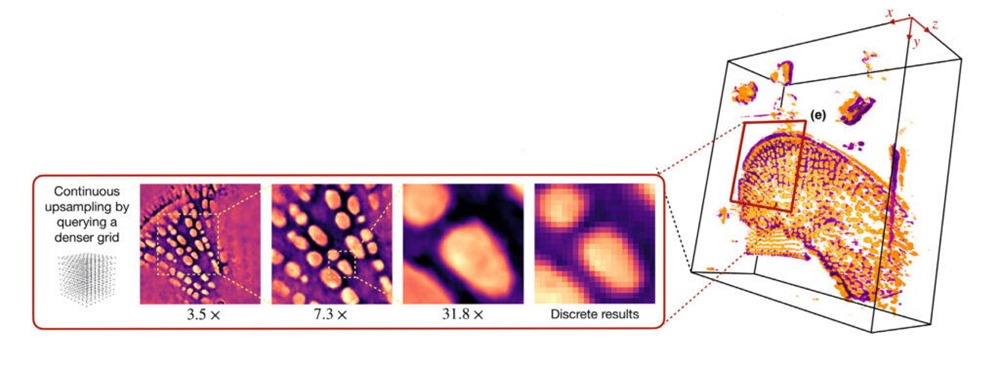

Image d’entête : le système d’imagerie peut faire un zoom sur une image pixélisée et remplir les parties manquantes, créant ainsi une représentation 3D continue. (Ulugbek Kamilov/ McKelvey School of Engineering WU)

Un tel système pourrait grandement améliorer l’interprétation des structures tridimensionnelles à partir d’images 2D, avec des applications potentielles dans des domaines allant de la science des matériaux à la médecine.

Selon Ulugbek Kamilov, professeur d’ingénierie et de science informatique :

Nous entraînons le modèle sur l’ensemble des images numériques pour obtenir une représentation continue. Maintenant, je peux le montrer comme je le veux. Je peux zoomer sans problème et il n’y a pas de pixellisation.

L’algorithme est basé sur un neural field network (réseau de champs neuronaux – réseau neuronal), une architecture particulière d’apprentissage automatique capable de relier des traits physiques à des coordonnées spatiales spécifiques. Après avoir reçu une formation adéquate, on peut demander à un tel système d’interpréter ce qu’il voit à n’importe quel endroit d’une image. Les réseaux de champs neuronaux ont été privilégiés comme base du nouvel algorithme, car ils nécessitent relativement moins de données pour la formation que les autres types de réseaux neuronaux. Ils peuvent être employés de manière fiable pour analyser une image, à condition que suffisamment d’échantillons 2D soient fournis pour l’analyse, explique l’équipe.

Pour cet algorithme particulier, le réseau a été entraîné en utilisant des images de microscopie standard. Il s’agissait d’images optiques de cellules : les échantillons étaient éclairés par le bas et la lumière qui les traversait était enregistrée.

Ces images ont ensuite été transmises au réseau, accompagnées d’informations concernant la structure interne de la cellule à des endroits précis des images. À partir de ces informations, on a demandé au réseau de recréer la structure globale des cellules qui lui étaient montrées. Ses résultats ont ensuite été jugés en fonction de leur capacité à refléter la réalité dans un processus répétitif.

Une fois que les prédictions du système correspondaient bien aux mesures réelles, le réseau fut considéré comme prêt. À ce stade, on lui a demandé de compléter les parties du modèle de la cellule qui ne pouvaient pas être capturées par des mesures directes en laboratoire.

(Renhao Liu et col./Nature)

L’équipe explique que l’un des avantages de son nouvel algorithme est qu’il supprime la nécessité pour les laboratoires de maintenir des galeries d’images denses en données de toutes les cellules avec lesquelles ils travaillent, car une représentation complète de sa structure peut être recréée chaque fois que le réseau en a besoin. Il permet également de manipuler le modèle comme jamais une photographie ne pourrait le faire.

Toujours selon Kamilov :

Je peux introduire n’importe quelle coordonnée et générer cette vue. Ou je peux générer des vues entièrement nouvelles sous différents angles.

Il peut ainsi utiliser le modèle pour tourner une cellule dans tous les sens ou zoomer pour l’observer de plus près, utiliser le modèle pour effectuer d’autres tâches numériques ou même l’intégrer dans un autre algorithme.

L’étude publiée dans la revue Nature Machine Intelligence : Recovery of continuous 3D refractive index maps from discrete intensity-only measurements using neural fields et présentée sur le site de de l’université de Washington à St. Louis : Machine learning generates 3D model from 2D pictures.