Les humains auront tendance à accorder plus de confiance à des visages générés par une intelligence artificielle

Non seulement les humains sont incapables de faire la différence entre les visages réels et des visages générés par une intelligence artificielle (IA), mais ils semblent également faire davantage confiance aux visages générés par cette dernière. Les résultats d’une étude relativement modeste suggèrent que des personnes mal intentionnées pourraient utiliser l’IA pour générer des visages artificiels et tromper les humains.

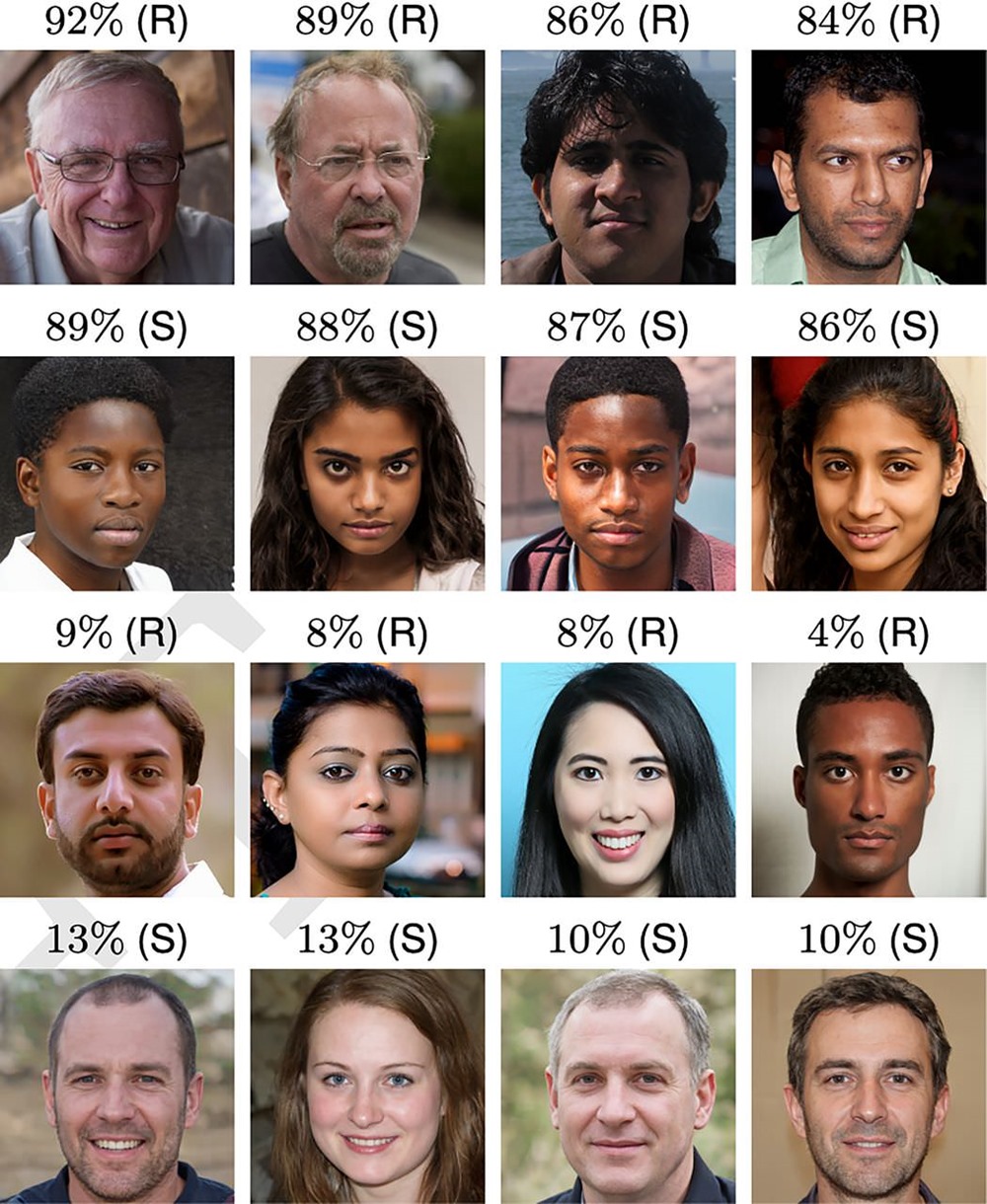

Images d’entête, à partir de l’étude : la classification la plus (haut et milieu supérieur) et la moins (bas et milieu inférieur) précise de visages réels (R) et artificiels (S). (Sophie J. Nightingale et Hany Farid/ PNAS)

Ces dernières années, l’intelligence artificielle a fait de grands progrès. Elle ne sert plus seulement à analyser des données, elle peut être utilisée pour créer du texte, des images et même des vidéos. La création de visages humains est une application particulièrement intrigante.

Au cours des deux dernières années, les algorithmes sont devenus étonnamment doués pour créer des visages humains. Cela pourrait être utile d’un certain point de vue, car cela permet à des entreprises disposant d’un petit budget de produire des publicités, par exemple, ce qui démocratise essentiellement l’accès à de précieuses ressources. Mais en même temps, les visages synthétisés par l’IA peuvent être utilisés à des fins de désinformation, de fraude, de propagande et même de vengeance pornographique.

Le cerveau humain est généralement assez bon pour distinguer le vrai du faux, mais dans ce domaine, les IA remportent la partie. Dans une nouvelle étude, Sophie Nightingale, de l’université de Lancaster au Royaume-Uni, et le professeur Hany Farid, de l’université de Californie à Berkeley (États-Unis), ont mené des expériences pour déterminer si des participants pouvaient distinguer des visages synthétisés par l’IA de visages réels et quel niveau de confiance ces visages suscitaient.

Selon les chercheurs :

Notre évaluation du réalisme photographique des visages synthétisés par l’IA indique que les outils de synthèse ont traversé la vallée de la peur et sont capables de créer des visages qui sont indiscernables, et plus dignes de confiance, que les visages réels.

Ces derniers ont élaboré trois expériences, en recrutant des volontaires sur la plateforme Mechanical Turk. Dans la première, 315 participants ont classé 128 visages parmi un ensemble de 800 (réels ou synthétisés). Leur précision était de 48 %, soit mieux qu’un tirage à pile ou face.

Dans la deuxième expérience, 219 nouveaux participants ont été formés à l’analyse et au feedback des visages. On leur a ensuite demandé de classer et d’évaluer 128 visages, toujours à partir d’un ensemble de 800. Leur précision a augmenté grâce à la formation, mais seulement à 59 %.

Dans la troisième expérience, 223 participants ont été invités à évaluer la fiabilité de 128 visages (parmi 800) sur une échelle de 1 à 7. Étonnamment, les visages artificiels ont été jugés 7,7 % plus fiables.

Toujours selon les chercheurs :

Les visages constituent une riche source d’informations. Une exposition de quelques millisecondes suffit pour faire des déductions implicites sur des caractéristiques individuelles telles que la fiabilité. Nous nous sommes demandé si les visages synthétiques activaient les mêmes jugements de fiabilité. Si ce n’est pas le cas, alors la perception de la fiabilité pourrait aider à distinguer les visages réels des visages synthétiques.

Peut-être plus intéressant encore, nous constatons que les visages générés synthétiquement sont plus dignes de confiance que les visages réels.

L’analyse a également permis de dégager quelques éléments intéressants. Par exemple, les femmes ont été jugées beaucoup plus dignes de confiance que les hommes, et les visages souriants étaient également plus dignes de confiance. Les visages noirs ont été jugés plus dignes de confiance que les visages sud-asiatiques, mais autrement, l’origine ne semble pas affecter la fiabilité.

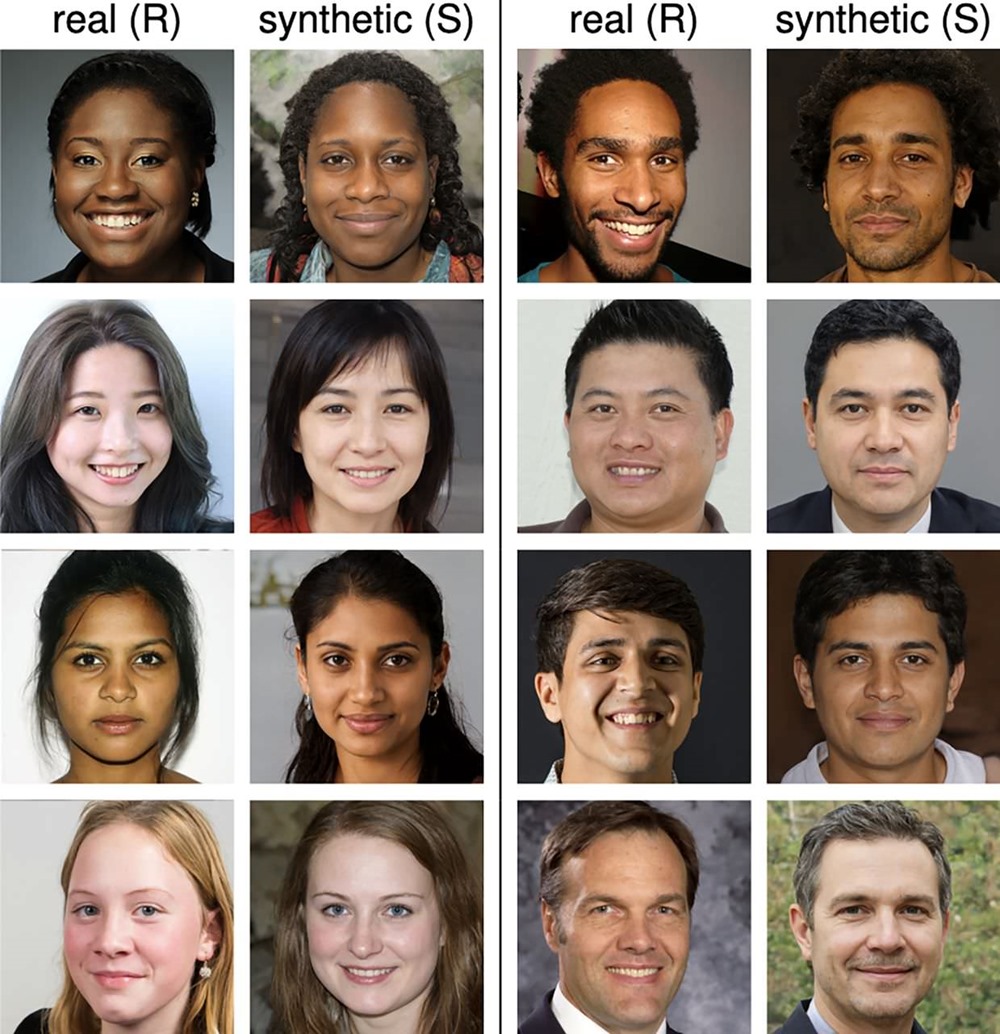

Visages représentatifs utilisés dans l’étude, réels versus artificiels. (Sophie J. Nightingale et Hany Farid/ PNAS)

Selon l’étude :

Un visage souriant est plus susceptible d’être jugé digne de confiance, mais 65,5 % des visages réels et 58,8 % des visages synthétiques sont souriants, de sorte que l’expression faciale ne peut expliquer à elle seule pourquoi les visages synthétiques sont jugés plus dignes de confiance.

Les chercheurs proposent une explication possible pour expliquer pourquoi les visages artificiels pourraient être considérés comme plus dignes de confiance : ils ont tendance à ressembler à des visages moyens/ communs, et des recherches antérieures ont suggéré que les visages moyens ont tendance à être considérés comme plus dignes de confiance.

Bien qu’il s’agisse d’un échantillon relativement petit et que les résultats doivent être reproduits à plus grande échelle, les conclusions sont assez inquiétantes, surtout si l’on considère la vitesse à laquelle la technologie a progressé. Les chercheurs affirment que si nous voulons protéger le public des « deepfake« , il devrait y avoir des lignes directrices sur la façon dont les images synthétisées sont créées et diffusées.

Pour les chercheurs :

Les sauvegardes pourraient inclure, par exemple, l’incorporation de filigranes solides dans les réseaux de synthèse d’images et de vidéos qui fourniraient un mécanisme en aval pour une identification fiable. Étant donné que c’est la démocratisation de l’accès à cette puissante technologie qui constitue la menace la plus importante, nous encourageons également le réexamen de l’approche souvent laxiste de la diffusion publique et sans restriction du code que chacun peut intégrer dans n’importe quelle application.

À ce moment charnière, et comme d’autres domaines scientifiques et d’ingénierie l’ont fait, nous encourageons la communauté du graphisme et de la vision à élaborer des lignes directrices pour la création et la distribution de technologies de médias synthétiques qui intègrent des directives éthiques pour les chercheurs, les éditeurs et les distributeurs de médias.

L’étude publiée dans PNAS : AI-synthesized faces are indistinguishable from real faces and more trustworthy et présentée sur le site de l’Université de Lancaster : AI generated faces are MORE trustworthy than real faces say researchers who warn of “deep fakes”.