Une intelligence artificielle recrée un extrait d’une chanson des Pink Floyd à partir d’enregistrements de l’activité cérébrale

Après une décennie de recherche, des scientifiques ont réussi à recréer une chanson à partir d’enregistrements cérébraux et avec l’aide d’une intelligence artificielle.

Comment le cerveau traite-t-il la musique et que se passe-t-il lorsque nous écoutons nos chansons préférées ? Ces questions fascinent les scientifiques depuis des décennies, et de récentes recherches ont permis de faire des progrès significatifs dans la description des bases neuronales de la perception et de la cognition musicales.

Des chercheurs ont déjà démontré que la musique réduit l’anxiété, la pression artérielle et la douleur, et qu’elle améliore la qualité du sommeil, l’humeur, la vivacité d’esprit et la mémoire. La musique mobilise un large éventail de réseaux cérébraux, allant au-delà du cortex auditif jusqu’aux zones liées à l’émotion qui se synchronisent pendant la musique émotionnelle. Elle stimule également les régions de la mémoire et, chose curieuse, elle active le système moteur. L’activation du système moteur du cerveau nous permettrait d’identifier le rythme de la musique avant même de commencer à taper du pied.

En bref, presque toutes les régions les plus importantes du cerveau sont activées en réponse à la musique. Ce que nous avons appris jusqu’à présent est tout à fait extraordinaire. Mais aujourd’hui, une nouvelle étude de l’université de Californie à Berkeley (Etats-Unis) repousse vraiment les limites des neurosciences en ce qui concerne la musique.

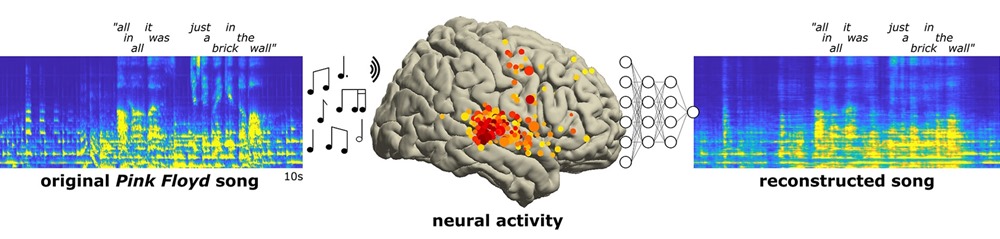

Grâce à une modélisation informatique de pointe, les scientifiques ont réussi à reconstituer le morceau « Another Brick in the Wall, Part 1 » de Pink Floyd à partir d’enregistrements neuronaux directs de l’activité du cortex auditif humain. En d’autres termes, en captant l’activité électrique du cerveau d’une personne pendant qu’elle écoutait la chanson, les scientifiques ont pu reconstituer la réponse neuronale à la chanson qui avait déclenché le stimulus.

Les chercheurs de l’Université de Californie (UC) à Berkeley (Etats-Unis) ont utilisé 2 668 électrodes pour capter l’activité cérébrale de 29 personnes écoutant le morceau des Pink Floyd de 1978, puis ils ont utilisé ce que les électrodes avaient recueilli pour recréer une version reconnaissable de la chanson à l’aide d’algorithmes informatiques.

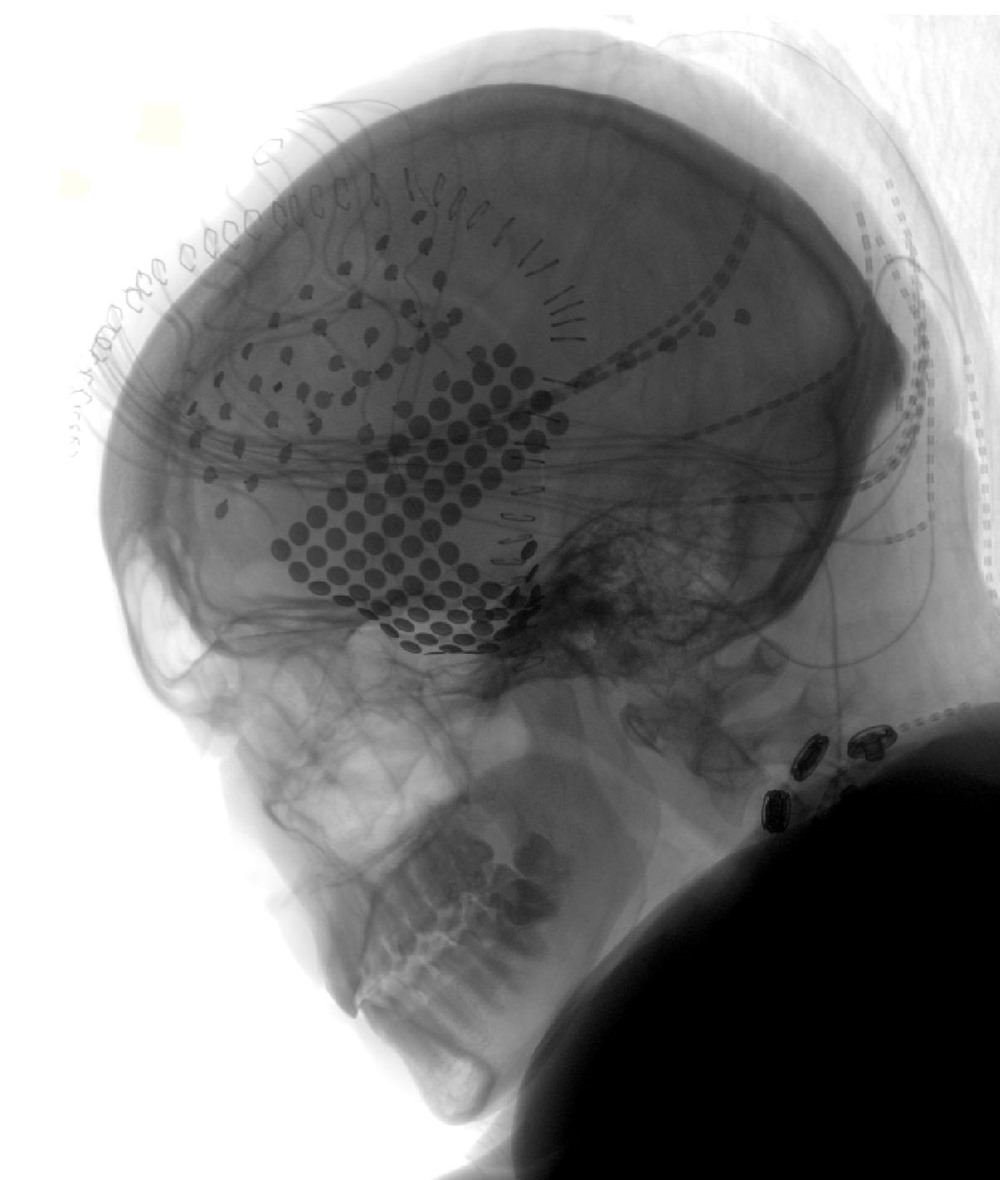

Image d’entête : une radiographie de la tête d’un participant à l’expérience montre le placement d’électrodes sur les régions frontale (en haut) et temporale (en bas) du cerveau. Ces électrodes ont été placées à la surface du cerveau pour localiser les points d’origine des crises d’épilepsie. Pendant qu’ils attendaient des jours dans leur chambre d’hôpital, les patients se sont portés volontaires pour d’autres études sur le cerveau, dont une visant à identifier les régions du cerveau qui réagissent à la musique. (Université de Californie à Berkeley )

Ce type de traduction algorithmique a déjà été utilisé pour recréer la parole à partir de scanners cérébraux, mais pas la musique. L’étude a également permis d’identifier une relation entièrement nouvelle entre le rythme et l’activité cérébrale, ainsi que l’endroit où celle-ci se produit.

Les résultats ont permis de découvrir des mécanismes inconnus dans le cerveau qui réagit au rythme, en particulier lorsque ces ondes sonores pénètrent dans nos oreilles. Cette découverte est particulièrement intéressante pour les scientifiques qui s’efforcent de trouver des moyens de recréer la prosodie, le rythme, l’accentuation et l’intonation, dans la parole (et la musique), alors que les mots ne la transmettent pas. Réussir à le faire pourrait constituer une percée pour les personnes ayant subi un accident vasculaire cérébral (AVC) ou une paralysie, ou ayant d’autres problèmes de communication verbale.

Selon Robert Knight, neurologue et professeur de psychologie à l’Institut des neurosciences Helen Wills de l’université de Berkeley, qui a mené l’étude avec Ludovic Bellier, chercheur postdoctoral :

C’est un merveilleux résultat. Pour moi, l’une des caractéristiques de la musique est qu’elle possède une prosodie et un contenu émotionnel. À mesure que progresse le domaine des interfaces cerveau-machine, cela permet d’ajouter de la musicalité aux futurs implants cérébraux pour les personnes qui en ont besoin, comme les personnes atteintes de SLA ou d’un autre trouble neurologique ou développemental invalidant qui compromet l’émission de la parole. Cela permet de décoder non seulement le contenu linguistique, mais aussi une partie du contenu prosodique de la parole, une partie de l’affect. Je pense que c’est ce que nous avons vraiment commencé à comprendre.

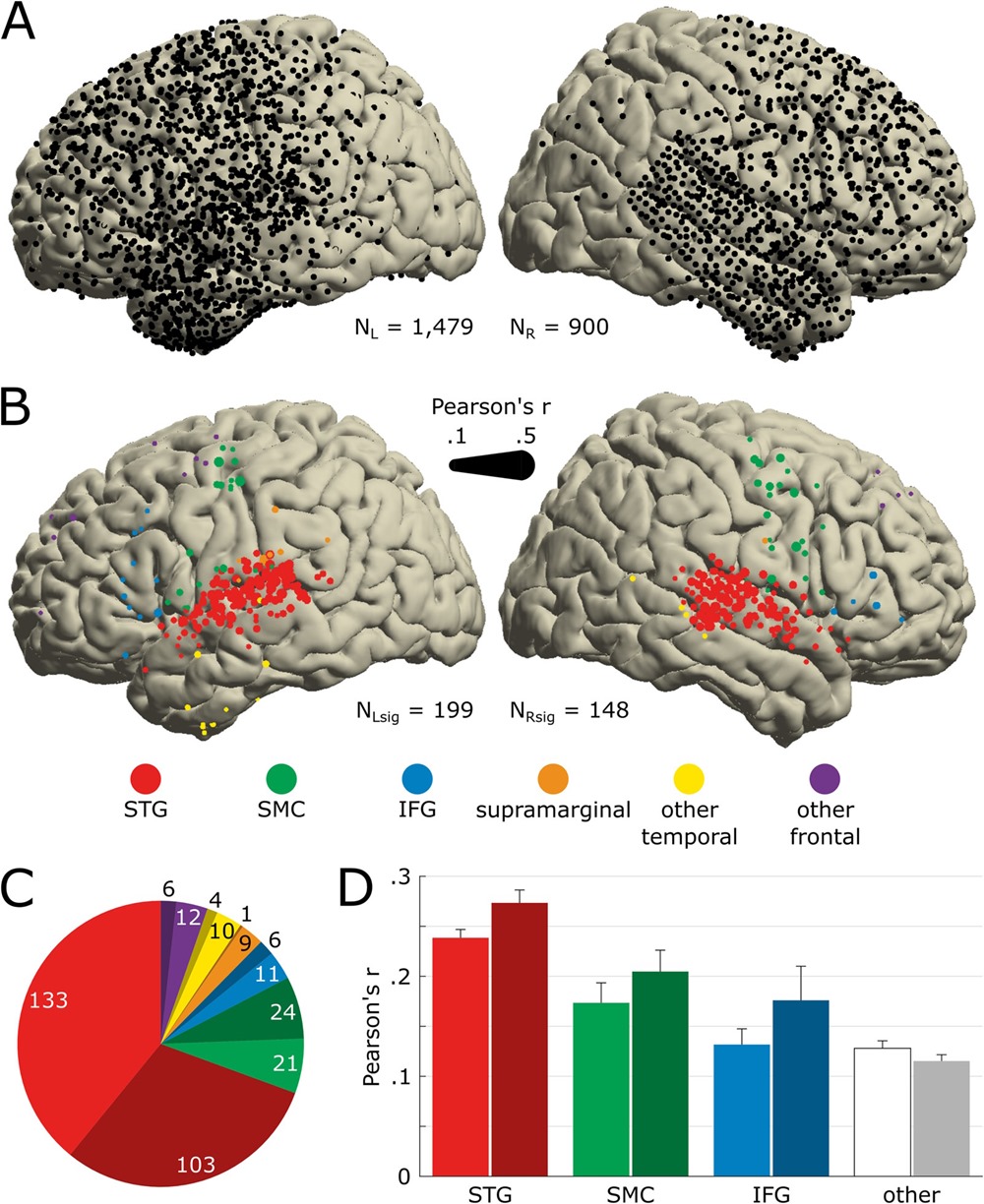

La musique a affecté 347 électrodes, dont la plupart sont situées dans le gyrus temporal supérieur, le cortex sensori-moteur et le gyrus frontal inférieur. Les scientifiques ont ainsi remarqué qu’une région unique du gyrus temporal supérieur réagissait à certains sons, et ils pensent qu’il s’agit de la zone qui se concentre sur le rythme (dans cet exemple, le rythme des guitares sur le morceau). Lorsqu’ils ont retiré les électrodes de cette région, la reconstruction du son s’est considérablement affaiblie, ce qui suggère que cette région joue un rôle clé dans la communication de la prosodie.

A partir de l’étude, de gauche à droite : forme d’onde de l’ensemble du stimulus de la chanson originale, localisation de l’activité neurale dans le cerveau et la forme d’onde de la chanson reconstituée par l’IA. (L. Bellier et col./ PLOS Biology)

Les scientifiques, dirigés par Ludovic Bellier de l’UC, pensent également que cette nouvelle sous-région corticale du lobe temporal sera importante pour la recherche et le développement futurs d’interfaces cerveau-machine, telles que des prothèses destinées à améliorer la perception du rythme et de la mélodie dans la parole.

Les scientifiques, dirigés par Ludovic Bellier de l’UC, pensent également que cette nouvelle sous-région corticale du lobe temporal sera importante pour la recherche et le développement futurs d’interfaces cerveau-machine, telles que des prothèses destinées à améliorer la perception du rythme et de la mélodie dans la parole.

A partir de l’étude : ce graphique montre les électrodes qui ont réagi à la musique, indiquant aux scientifiques la direction de la nouvelle zone du cerveau qui traite le rythme. (L. Bellier et col./ PLOS Biology)

Selon Knight :

Le langage relève davantage du cerveau gauche. La musique est plus répartie, avec un biais vers la droite. Il n’était pas évident qu’il en soit de même pour les stimuli musicaux. Nous confirmons ici qu’il ne s’agit pas d’un phénomène spécifique à la parole, mais qu’il est plus fondamental pour le système auditif et la manière dont il traite à la fois la parole et la musique.

Vous pouvez écouter les résultats combinés des 29 cerveaux dont l’activité cérébrale a reproduit la chanson pour la capturer et la traiter.

Le morceau original écouté :

La reconstruction à partir de l’activité cérébrale :

L’étude publiée dans PLOS Biology : Music can be reconstructed from human auditory cortex activity using nonlinear decoding models et présentée sur le site de l’Université de Californie à Berkeley : Brain recordings capture musicality of speech — with help from Pink Floyd.