Des chercheurs peuvent désormais modéliser une pièce en 3D à partir des reflets de vos yeux

La technologie du champ de rayonnement neuronal (NeRF pour Neural radiance field) commence à montrer d’incroyables capacités à transformer des images et des vidéos 2D en modèles 3D, mais des chercheurs de l’université du Maryland (Etats-Unis) ont franchi une nouvelle étape en n’utilisant rien d’autre que les reflets de l’œil.

Pour donner un exemple de la technologie NeRF, imaginez que vous marchez autour d’une scène en prenant des photos ou des vidéos avec un smartphone, puis vous téléchargez les résultats vers un service où un réseau neuronal utilise une variété de techniques d’intelligence artificielle pour prendre une séquence d’images du monde réel et l’utiliser pour construire un modèle en 3D de votre sujet et de son environnement.

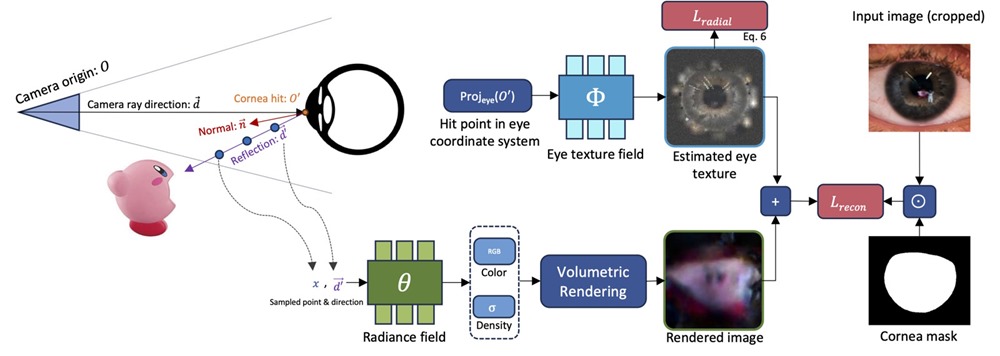

Dans une étude en prépublication (pas encore évaluée par les pairs), des chercheurs montrent comment ils sont capables de prendre plusieurs images haute définition d’une personne se déplaçant dans une pièce, puis de zoomer pour observer les reflets dans leur cornée, de les retourner, de supprimer la couleur et les détails que l’iris pourrait ajouter, de les traiter pour supprimer la distorsion du miroir incurvé et de les utiliser pour créer des images en 3D.

Présentation de la procédure de reconstruction 3D. (world-from-eyes.github.io)

Certes, ces modèles 3D ne sont pas de très haute résolution. On peut distinguer les objets, mais pas dans les moindres détails, et l’équipe a dû utiliser un éclairage spécifique pour faire ressortir l’effet. Et il est difficile de dire exactement qui aurait besoin de ce type de technologie, et pour quoi, à moins qu’il ne s’agisse d’un scénario de type « Mission Impossible ».

Les chercheurs ont imaginé un scénario réel pour tester ce matériel : ils ont zoomé sur les reflets des yeux dans des clips vidéo de Miley Cyrus et de Lady Gaga, en espérant tirer parti d’une vision rapprochée de qualité et de situations d’éclairage favorables. Malheureusement, la résolution n’était pas suffisante et le résultat le plus proche qu’ils ont pu obtenir est que Miley Cyrus regardait peut-être une grille d’éclairage et que Lady Gaga regardait peut-être quelque chose qui ressemblait très légèrement au torse d’une personne.

Quoi qu’il en soit, c’est un aperçu fascinant de la quantité d’informations que l’on peut tirer d’une scène. Cela rappelle un peu une idée folle que le MIT a étudiée en 2014, dans laquelle ils ont réussi à reconstruire une partie de l’audio à l’intérieur d’une pièce scellée en prenant une vidéo à grande vitesse d’un paquet de chips et en l’analysant pour la distorsion afin de construire une forme d’onde audio.

A découvrir sur le site dédié à ces travaux : Seeing the World Through Your Eyes.

Il n’y a aucune publicité sur GuruMeditation et le Guru ne compte que sur la reconnaissance de ses lecteurs/ lectrices.

Merci pour votre aide !

La technologie du champ de rayonnement neuronal (NeRF pour Neural radiance field) commence à montrer d’incroyables capacités à transformer des images et des vidéos 2D en modèles 3D, mais des chercheurs de l’université du Maryland (Etats-Unis) ont franchi une nouvelle étape en n’utilisant rien d’autre que les reflets de l’œil.

Pour donner un exemple de la technologie NeRF, imaginez que vous marchez autour d’une scène en prenant des photos ou des vidéos avec un smartphone, puis vous téléchargez les résultats vers un service où un réseau neuronal utilise une variété de techniques d’intelligence artificielle pour prendre une séquence d’images du monde réel et l’utiliser pour construire un modèle en 3D de votre sujet et de son environnement.

Dans une étude en prépublication (pas encore évaluée par les pairs), des chercheurs montrent comment ils sont capables de prendre plusieurs images haute définition d’une personne se déplaçant dans une pièce, puis de zoomer pour observer les reflets dans leur cornée, de les retourner, de supprimer la couleur et les détails que l’iris pourrait ajouter, de les traiter pour supprimer la distorsion du miroir incurvé et de les utiliser pour créer des images en 3D.

Présentation de la procédure de reconstruction 3D. (world-from-eyes.github.io)

Certes, ces modèles 3D ne sont pas de très haute résolution. On peut distinguer les objets, mais pas dans les moindres détails, et l’équipe a dû utiliser un éclairage spécifique pour faire ressortir l’effet. Et il est difficile de dire exactement qui aurait besoin de ce type de technologie, et pour quoi, à moins qu’il ne s’agisse d’un scénario de type « Mission Impossible ».

Les chercheurs ont imaginé un scénario réel pour tester ce matériel : ils ont zoomé sur les reflets des yeux dans des clips vidéo de Miley Cyrus et de Lady Gaga, en espérant tirer parti d’une vision rapprochée de qualité et de situations d’éclairage favorables. Malheureusement, la résolution n’était pas suffisante et le résultat le plus proche qu’ils ont pu obtenir est que Miley Cyrus regardait peut-être une grille d’éclairage et que Lady Gaga regardait peut-être quelque chose qui ressemblait très légèrement au torse d’une personne.

Quoi qu’il en soit, c’est un aperçu fascinant de la quantité d’informations que l’on peut tirer d’une scène. Cela rappelle un peu une idée folle que le MIT a étudiée en 2014, dans laquelle ils ont réussi à reconstruire une partie de l’audio à l’intérieur d’une pièce scellée en prenant une vidéo à grande vitesse d’un paquet de chips et en l’analysant pour la distorsion afin de construire une forme d’onde audio.

A découvrir sur le site dédié à ces travaux : Seeing the World Through Your Eyes.

C’est clairement impressionnant ! (même si effectivement, difficile de comprendre l’utilité au premier abord)