Veni, Vidi, Vici : sans instructions ni aide, une intelligence artificielle domine désormais les humains dans un célèbre jeu vidéo multijoueur

Auparavant jugé trop compliqué, même pour les algorithmes, un agent intelligent (du domaine de l’intelligence artificielle (IA)) a été mis au point pour remporter des parties multijoueurs en ligne.

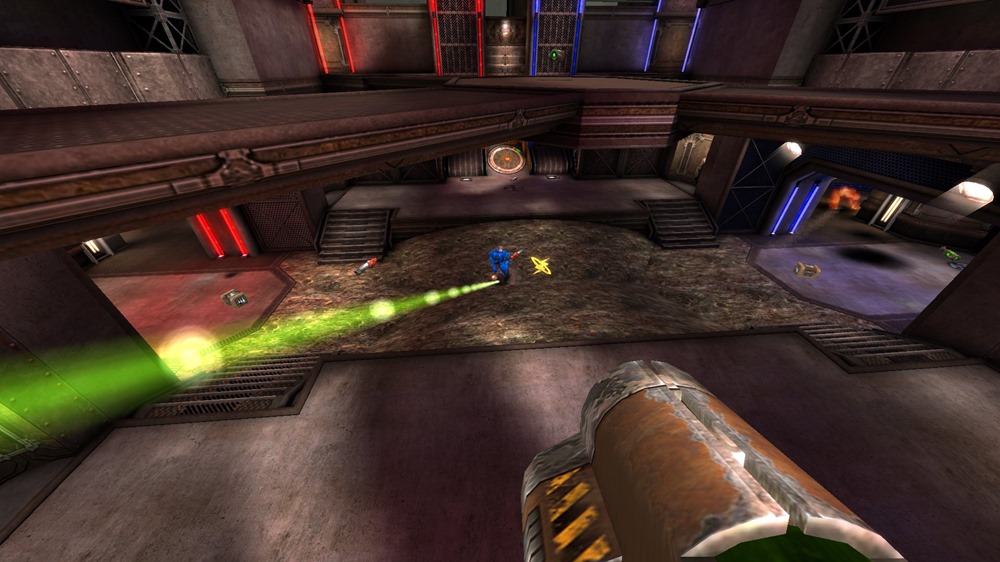

N’utilisant rien d’autre que le même point de vue basé sur les pixels et la même connaissance de l’état du jeu que les joueurs humains, les scientifiques dirigés par Max Jaderberg de la société de recherche DeepMind, propriété de Google, ont généré des agents d’IA pour jouer à une variante du jeu populaire Quake III Arena, appelé Capture the Flag (Capture de drapeaux), qui oppose deux équipes dans des environnements générés aléatoirement et qui doivent trouver et capturer des drapeaux ennemis dans la carte.

L’équipe a développé les agents en utilisant des techniques d’apprentissage par renforcement à travers le gameplay, et après 450 000 parties, les robots ont été en mesure de battre des joueurs humains professionnels, un exploit non négligeable dans un environnement si complexe avec autant de variables.

(Deepmind)

L’un des trois paradigmes de l’apprentissage machine, avec l’apprentissage supervisé et l’apprentissage non supervisé, l’apprentissage par renforcement n’utilise pas de combinaisons définitives d’entrées-sorties et n’exige pas la correction ou l’effacement des actions imparfaites.

Au lieu de cela, il équilibre l’exploration d’un domaine inconnu avec la découverte de toute connaissance recueillie à son sujet, parfait pour des conditions en perpétuelle évolution parmi un grand nombre d’agents, tels que ceux présents dans un jeu multijoueur.

Le but de l’étude DeepMind était que les agents apprennent vraiment par eux-mêmes lorsqu’ils commencent avec les mêmes informations dont disposerait un joueur humain. Cela signifiait aucune connaissance des règles et aucune capacité de communiquer et de partager des informations en dehors du jeu, alors que les précédentes itérations de travaux similaires donnaient les modèles logiciels de l’environnement ou l’état des autres acteurs.

Le processus d’apprentissage est optimisé en laissant les agents perdre un grand nombre de parties à la fois, en rassemblant les résultats pour obtenir une vue descendante des trucs et astuces que chaque agent a appris et en distribuant ensuite ces connaissances à la génération suivante. Comme un joueur humain, ils glanent de l’expérience sur la stratégie qui est ensuite applicable à une nouvelle carte, même s’ils ne connaissent pas sa disposition et sa topologie, ni l’intention ou la position des autres joueurs.

La capture du drapeau est jouée dans des environnements générés procéduralement, de sorte que les agents doivent généraliser à des cartes inconnues. (Deepmind)

Dans de telles circonstances, selon Jaderberg et ses collègues :

Le résultat est suffisamment incertain pour fournir un signal d’apprentissage significatif.

Le processus d’apprentissage par renforcement s’est déroulé en deux étapes, de l’optimisation du comportement d’un seul agent pour obtenir des récompenses qui est ensuite mise en correspondance avec les « hyper-paramètres » de l’ensemble des données. Les agents moins performants sont remplacés par des descendants qui internalisent les leçons apprises à tous les niveaux, une pratique également appelée » formation basée sur la population » (population-based training).

Les résultats furent remarquables. Même lorsque le système a ralenti les temps de réaction des agents jusqu’à ce qu’ils atteignent des niveaux humains moyens, ils ont tout de même atteint et dépassé les performances de ces derniers. Après des heures d’entraînement, les joueurs humains n’ont pas été capables de les battre dans plus de 25% des tentatives, et plus intéressant encore, les agents IA ont découvert et employé des tactiques gagnantes qui étaient couramment utilisées par les joueurs humains.

Mais l’ingrédient secrèt pourrait être dans la méthodologie parallèle et multijeu. Des systèmes similaires d’auto-apprentissage permettent aux agents intelligents de tester ce qu’ils ont appris par rapport à leurs propres politiques en un seul exercice, ils jouent littéralement contre eux-mêmes.

Outre leur performance au jeu Quake III Arena, les chercheurs notent que c’est l’évolutivité de l’approche qui offre des applications passionnantes sur des systèmes multi-agents où un apprentissage stable est nécessaire.

L’étude publiée dans Science : Human-level performance in 3D multiplayer games with population-based reinforcement learning et présentée sur le site de Deepmind : Capture the Flag: the emergence of complex cooperative agents.

Bon il ne reste plus qu’a connecter ça aux robots de chez Boston Dynamics et de leur donner une arme réel.

C’est fascinant la quantité d’effort et de motivation que fourni l’homme pour scier sa propre branche. Triste futur