Une Intelligence artificielle détecte les “hypertrucages” en analysant la réflexion renvoyée par les yeux

Des chercheurs ont mis au point un algorithme qui permet d’identifier des portraits “hypertruqué” (deepfake) en observant leurs yeux.

Des informaticiens de l’Université d’État de New York à Buffalo ont créé cet algorithme de détection des faux visages, ou détournés, qui analyse les reflets dans les yeux des portraits pour déterminer leur authenticité.

Dans une étude publiée la semaine dernière (lien plus bas), les chercheurs affirment que l’algorithme est efficace à 94 % pour identifier les fausses images. Il s’agit d’une nouvelle et fascinante approche pour vérifier de la réalité d’images et de vidéos.

La raison pour laquelle l’algorithme est capable de détecter les fausses images est étonnamment simple : les intelligences artificielles de type « deepfake » sont incapables de créer des réflexions oculaires précises.

Selon le Dr Siwei Lyu, professeur à l’Université d’État de New York (SUNY Empire Innovation) et auteur principal de l’étude :

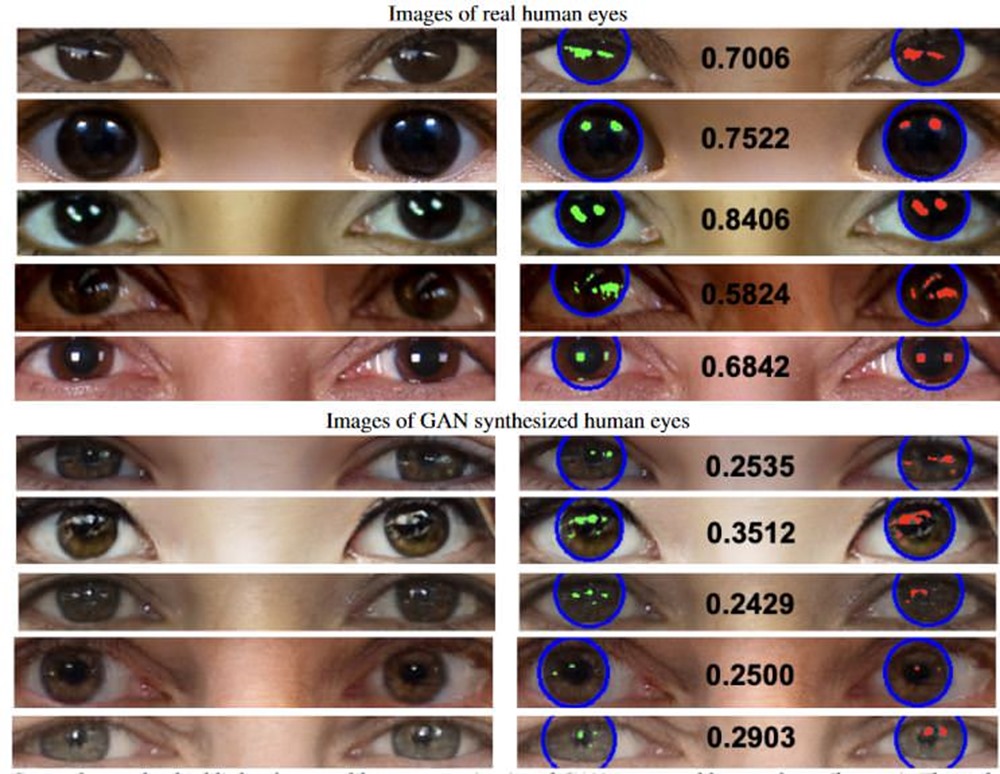

La cornée est presque comme une demi-sphère parfaite et elle est très réfléchissante. Ainsi, tout ce qui arrive à l’œil avec une lumière émise par ces sources aura une image sur la cornée.

Les deux yeux devraient présenter des motifs de réflexion très similaires parce qu’ils voient la même chose. C’est quelque chose que nous ne remarquons généralement pas lorsque nous regardons un visage.

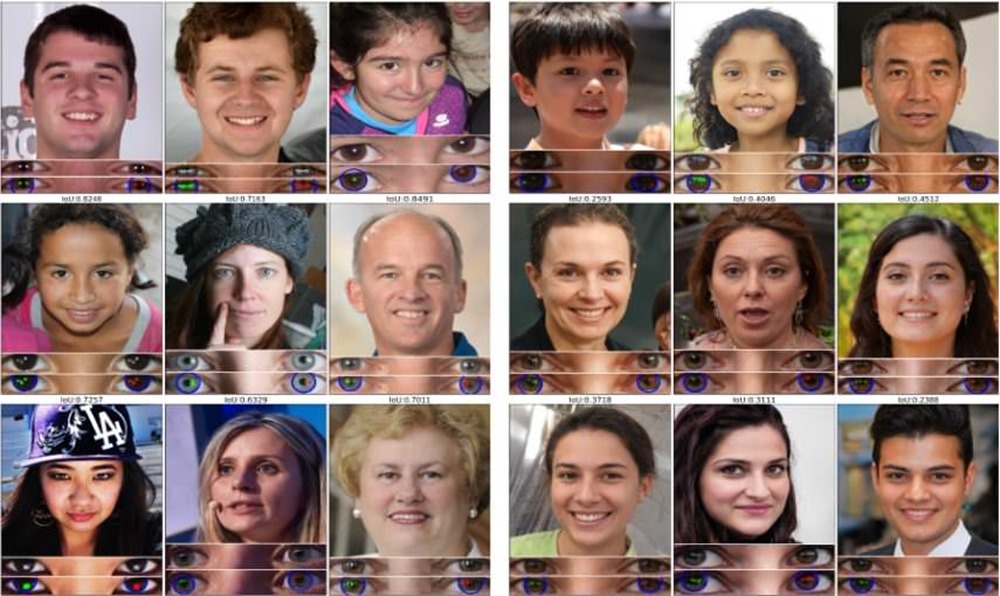

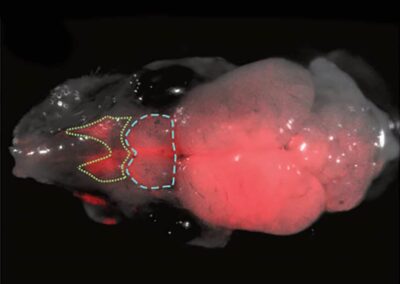

Cependant, l’IA deepfake est étonnamment inapte à créer des reflets cohérents dans les deux yeux, vous pouvez d’ailleurs le voir par vous-même en utilisant les images ci-dessous, tirées de l’étude, de vrais yeux humains et de ceux générés par l’IA :

(Shu Hu/ Yuezun Li/ Siwei Lyu/ Computer Science and Engineering – University at Buffalo/ arXiv)

Le développement de l’algorithme s’inscrit dans le cadre de la campagne de M. Lyu, visant à attirer l’attention sur le besoin croissant d’outils permettant de repérer les « deepfakes ».

Selon Lyu :

Malheureusement, une grande partie de ce type de fausses vidéos a été créée à des fins pornographiques, et cela a causé beaucoup de dommages psychologiques aux victimes. Il y a aussi l’impact politique potentiel, une fausse vidéo montrant des politiciens disant ou faisant quelque chose qu’ils ne sont pas censés faire. C’est mauvais.

L’étude en prépublication dans arXiv : Exposing GAN-Generated faces using consistent corneal specular highlights et présentée sur le site de l’Université de Buffalo : How to spot deepfakes? Look at light reflection in the eyes, qui a également mis à disposition un site générateur de faux visages (visages générés par une IA) : This person does not exist.

Des chercheurs ont mis au point un algorithme qui permet d’identifier des portraits “hypertruqué” (deepfake) en observant leurs yeux.

Des informaticiens de l’Université d’État de New York à Buffalo ont créé cet algorithme de détection des faux visages, ou détournés, qui analyse les reflets dans les yeux des portraits pour déterminer leur authenticité.

Dans une étude publiée la semaine dernière (lien plus bas), les chercheurs affirment que l’algorithme est efficace à 94 % pour identifier les fausses images. Il s’agit d’une nouvelle et fascinante approche pour vérifier de la réalité d’images et de vidéos.

La raison pour laquelle l’algorithme est capable de détecter les fausses images est étonnamment simple : les intelligences artificielles de type « deepfake » sont incapables de créer des réflexions oculaires précises.

Selon le Dr Siwei Lyu, professeur à l’Université d’État de New York (SUNY Empire Innovation) et auteur principal de l’étude :

La cornée est presque comme une demi-sphère parfaite et elle est très réfléchissante. Ainsi, tout ce qui arrive à l’œil avec une lumière émise par ces sources aura une image sur la cornée.

Les deux yeux devraient présenter des motifs de réflexion très similaires parce qu’ils voient la même chose. C’est quelque chose que nous ne remarquons généralement pas lorsque nous regardons un visage.

Cependant, l’IA deepfake est étonnamment inapte à créer des reflets cohérents dans les deux yeux, vous pouvez d’ailleurs le voir par vous-même en utilisant les images ci-dessous, tirées de l’étude, de vrais yeux humains et de ceux générés par l’IA :

(Shu Hu/ Yuezun Li/ Siwei Lyu/ Computer Science and Engineering – University at Buffalo/ arXiv)

Le développement de l’algorithme s’inscrit dans le cadre de la campagne de M. Lyu, visant à attirer l’attention sur le besoin croissant d’outils permettant de repérer les « deepfakes ».

Selon Lyu :

Malheureusement, une grande partie de ce type de fausses vidéos a été créée à des fins pornographiques, et cela a causé beaucoup de dommages psychologiques aux victimes. Il y a aussi l’impact politique potentiel, une fausse vidéo montrant des politiciens disant ou faisant quelque chose qu’ils ne sont pas censés faire. C’est mauvais.

L’étude en prépublication dans arXiv : Exposing GAN-Generated faces using consistent corneal specular highlights et présentée sur le site de l’Université de Buffalo : How to spot deepfakes? Look at light reflection in the eyes, qui a également mis à disposition un site générateur de faux visages (visages générés par une IA) : This person does not exist.