Perception de visages codés par le son chez des sujets aveugles

Des neuroscientifiques ont montré que les aveugles reconnaissent des visages ordinaires en utilisant les mêmes régions cérébrales que les voyants, même si les formes des visages sont transmises sous forme audio plutôt que par le cortex visuel, dans une intéressante étude sur la neuroplasticité.

La capacité à reconnaître les visages est profondément ancrée chez l’humain, ainsi que chez certains de nos éloignés cousins primates et sociaux. En effet, il semble que certaines régions du cerveau, notamment un point situé à l’arrière du cerveau, dans le gyrus temporal inférieur, appelé zone fusiforme du visage (FFA pour fusiform face area), s’activent spécifiquement lorsque nous voyons des visages.

Il est intéressant de noter qu’une étude réalisée en 2009 a montré que la FFA s’active même lorsque des personnes voient des objets qui ressemblent un peu à des visages. Elle est donc impliquée dans le phénomène de la paréidolie, qui consiste à voir des visages dans des objets inanimés.

Un exemple de paréidolie pour le visage.

La même zone commence également à s’activer lorsque des humains commencent à développer une expertise dans un domaine particulier, ce qui aide apparemment les passionnés d’automobile à distinguer visuellement différents modèles, par exemple, ou les experts en échecs à reconnaître une configuration familière sur l’échiquier.

Des recherches menées par le Massachusetts Institute of Technology (MIT) en 2020 ont placé des aveugles dans un scanner IRMf et leur ont fait toucher diverses formes imprimées en 3D, notamment des visages, des mains, des chaises et des labyrinthes, et ils ont constaté que le fait de toucher ces petits visages activait la FFA de la même manière. Il semble donc que le FFA ne se soucie pas, dans un certain sens, du système sensoriel qui lui fournit les informations relatives au visage. De nouvelles recherches menées par une équipe de neuroscientifiques du Georgetown University Medical Center (de l’Université de Georgetown/ États-Unis) viennent étayer cette hypothèse.

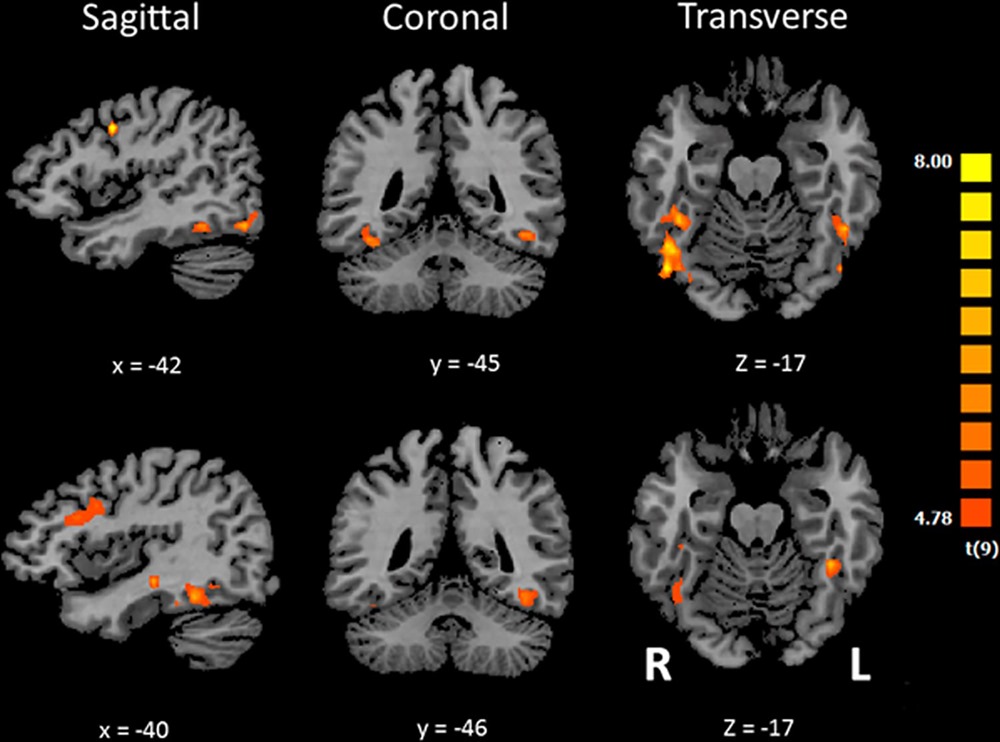

A partir de l’étude : activation visuelle de l’aire fusiforme du visage chez les sujets visualisant une représentation schématique de visages. (P. Plaza et col./ PLOS)

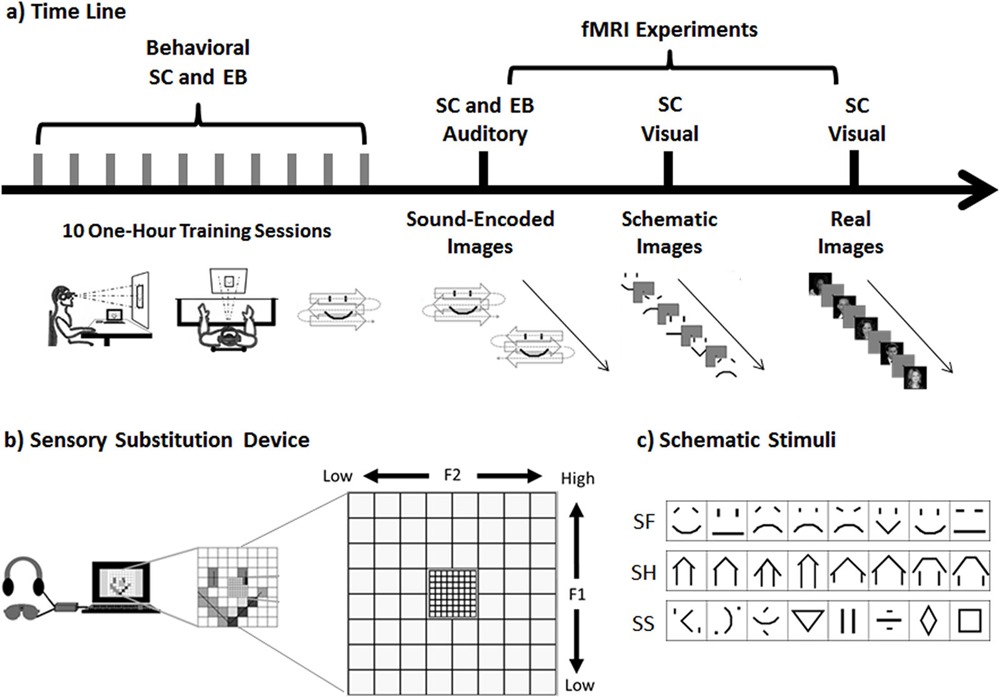

L’équipe a recruté six sujets aveugles et dix sujets voyants, et elle a commencé à les entraîner à l’aide d’un « dispositif de substitution sensorielle ». Ce dernier comprend une caméra vidéo montée sur la tête, des oculaires pour les yeux bandés, un casque et un ordinateur capable de traiter les données de la caméra vidéo et de les traduire en audio, en divisant le champ de vision en une grille de 64 pixels et en donnant à chaque pixel sa propre tonalité auditive. Ces sons sont également présentés dans une scène sonore stéréo, de sorte que, selon le document de recherche :

Si l’image n’est qu’un point situé dans le coin supérieur droit du champ de vision de la caméra, le son correspondant sera de haute fréquence et diffusé principalement par le casque droit. Si le point est situé dans le milieu supérieur du champ de vision, le son sera une tonalité à haute fréquence, mais émis par les écouteurs de droite et de gauche à un volume égal. Si l’image est une ligne située dans le coin inférieur gauche, le son associé sera un mélange de basses fréquences délivrées principalement par le casque gauche.

Les sujets ont passé 10 séances d’une heure à s’entraîner avec ces appareils, apprenant à « voir » avec leurs oreilles, tout en bougeant la tête. Les cartes présentaient des formes simples, des lignes horizontales et verticales, des maisons de formes différentes, des figures géométriques et des visages joyeux et tristes de type emoji. Il s’agissait d’un processus de formation assez difficile, mais à la fin, tous les sujets reconnaissaient des formes simples avec une précision supérieure à 85 %.

A partir de l’étude : les dispositifs de substitution sensorielle avaient une résolution de 64 pixels seulement. En bas à droite se trouvent quelques-unes des formes présentées aux sujets. (P. Plaza et col./ PLOS)

Lorsqu’ils ont été soumis à des tests de reconnaissance de formes dans une machine IRMf, les sujets voyants et aveugles ont montré une activation de la FFA lorsqu’une forme de visage de base leur était présentée. Certains participants aveugles ont également été capables d’identifier correctement si le visage était joyeux ou triste, comme vous pouvez l’entendre et le voir dans l’extrait ci-dessous de l’étude, qui vous donnera également une idée du son de l’appareil.

Lorsqu’ils ont été soumis à des tests de reconnaissance de formes dans une machine IRMf, les sujets voyants et aveugles ont montré une activation de la FFA lorsqu’une forme de visage de base leur était présentée. Certains participants aveugles ont également été capables d’identifier correctement si le visage était joyeux ou triste, comme vous pouvez l’entendre et le voir dans l’extrait ci-dessous de l’étude, qui vous donnera également une idée du son de l’appareil.

A partir de l’étude : test de perception des visages codés par le son chez des sujets aveugles. (P. Plaza et col./ PLOS)

Selon Josef Rauschecker, PhD, DSc, professeur de neurosciences et auteur principal de l’étude :

Nos résultats chez les personnes aveugles impliquent que le développement de l’aire fusiforme du visage ne dépend pas de l’expérience visuelle de visage, mais de l’exposition à la géométrie des configurations faciales, qui peut être transmise par d’autres modalités sensorielles.

L’équipe a également constaté que les sujets voyants présentaient une activation principalement dans la zone fusiforme droite du visage, tandis que les sujets aveugles présentaient une activation dans la zone fusiforme gauche du visage.

Selon Rauschecker :

Nous pensons que la différence gauche/droite entre les personnes aveugles et non aveugles peut être liée à la façon dont les côtés gauche et droit de l’aire fusiforme traitent les visages, soit comme des modèles connectés, soit comme des parties séparées, ce qui peut être un indice important pour nous aider à affiner notre dispositif de substitution sensorielle.

L’équipe souhaite poursuivre les expériences, en développant éventuellement un dispositif de substitution sensorielle à plus haute résolution qui pourrait à terme permettre à des sujets très entraînés de reconnaître de véritables visages humains. Cependant, il est peu probable que de tels dispositifs de traduction image-son soient d’une grande utilité dans la pratique, en partie à cause de la formation qu’ils requièrent, et en partie parce que les aveugles dépendent déjà fortement de leur ouïe et qu’il est peu probable qu’ils veuillent que des signaux sonores supplémentaires viennent perturber leur perception du monde. De plus, avec l’essor de l’IA multimodale à apprentissage profond ou l’IA générative, il existe déjà des systèmes qui permettent à des modèles de langage de type GPT de regarder des images ou des vidéos et de décrire ce qui s’y passe avec le niveau de détail que vous préférez. Ce type de narration en langage naturel pourrait s’avérer beaucoup plus facile à mettre en œuvre, à utiliser et à adapter aux besoins d’une personne qu’un flux vidéo-audio direct. Quoi qu’il en soit, il s’agit d’un outil fascinant, qui montre à quel point la vieille forme des « deux yeux et une bouche » est profondément ancrée dans notre cerveau, et l’importance de ces formes pour nous en tant qu’animaux sociaux. L’étude publiée dans PLOS : Sound-encoded faces activate the left fusiform face area in the early blind et présentée sur le site de la Georgetown University School of Medicine : Researchers Pinpoint Brain Area Where People Who Are Blind Recognize Faces Identified by Sound.